TL;DR: Was sind ISP-Proxys? Es handelt sich um statische Privat-IPs, die in einem Rechenzentrum gehostet werden. Erkennungssysteme sehen eine private ASN; Sie profitieren vom Durchsatz des Rechenzentrums. Sie sind die richtige Wahl, wenn Sitzungen, Account-Bindung und vorhersehbare Preise pro IP wichtiger sind als die reine geografische Reichweite.

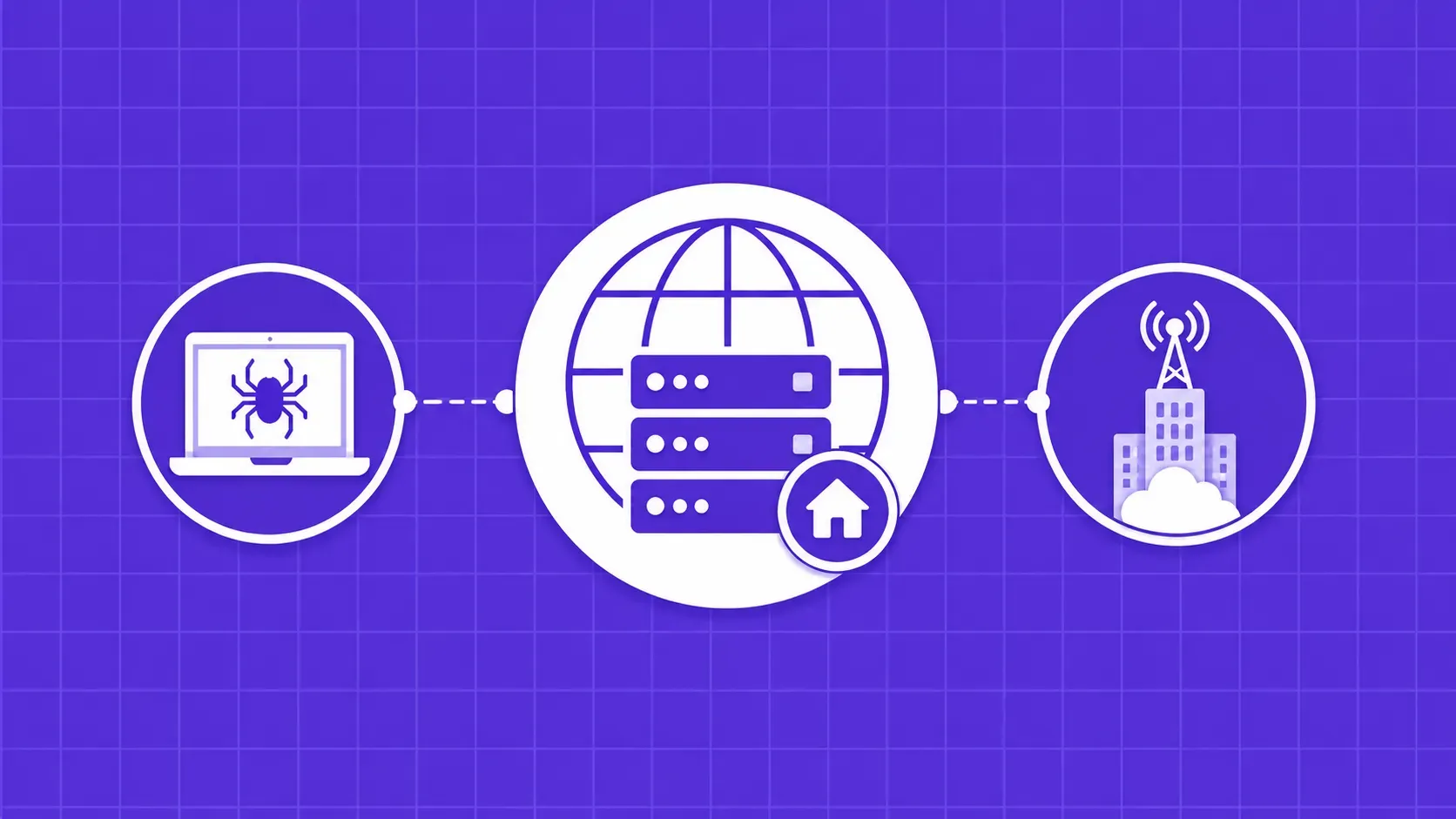

Was sind also ISP-Proxys, und warum verlagern Praktiker ihre Workloads von rotierenden privaten Pools auf eine statische IP, die in einem Rechenzentrum gehostet wird? Auf einer hohen Ebene ist ein ISP-Proxy ein Proxy-Server, der sich in einem Rechenzentrum befindet, aber eine IP-Adresse offenlegt, die von einem echten Internetdienstanbieter zugewiesen wurde. Erkennungssysteme sehen Datenverkehr von einer privaten ASN, während Ihr Code die Bandbreite und das Latenzprofil einer Cloud-Infrastruktur erhält.

Der Rest des Proxy-Marktes teilt sich in zwei bekanntere Kategorien auf: Rechenzentrums-Proxys (günstig und schnell, aber leicht zu erkennen, da sich viele Nutzer dieselben IPs teilen) und Residential-Proxys (vertrauenswürdige IPs, die über echte Privathaushaltsverbindungen geleitet werden, aber langsamer sind und nach Gigabyte abgerechnet werden). ISP-Proxys liegen dazwischen. Sie werden manchmal als statische Residential-Proxys bezeichnet, da die IP zu einem echten ISP-Block gehört, aber über alle Anfragen hinweg gleich bleibt.

Wenn Sie Scraping-Pipelines, SEO-Monitore, Anzeigenüberprüfungs-Scans oder Social-Media-Workflows mit mehreren Konten aufbauen, hat die Antwort auf die Frage, was ISP-Proxys sind und wann man sie einsetzt, direkten Einfluss auf Blockierungsrate, Durchsatz und Sitzungsstabilität.