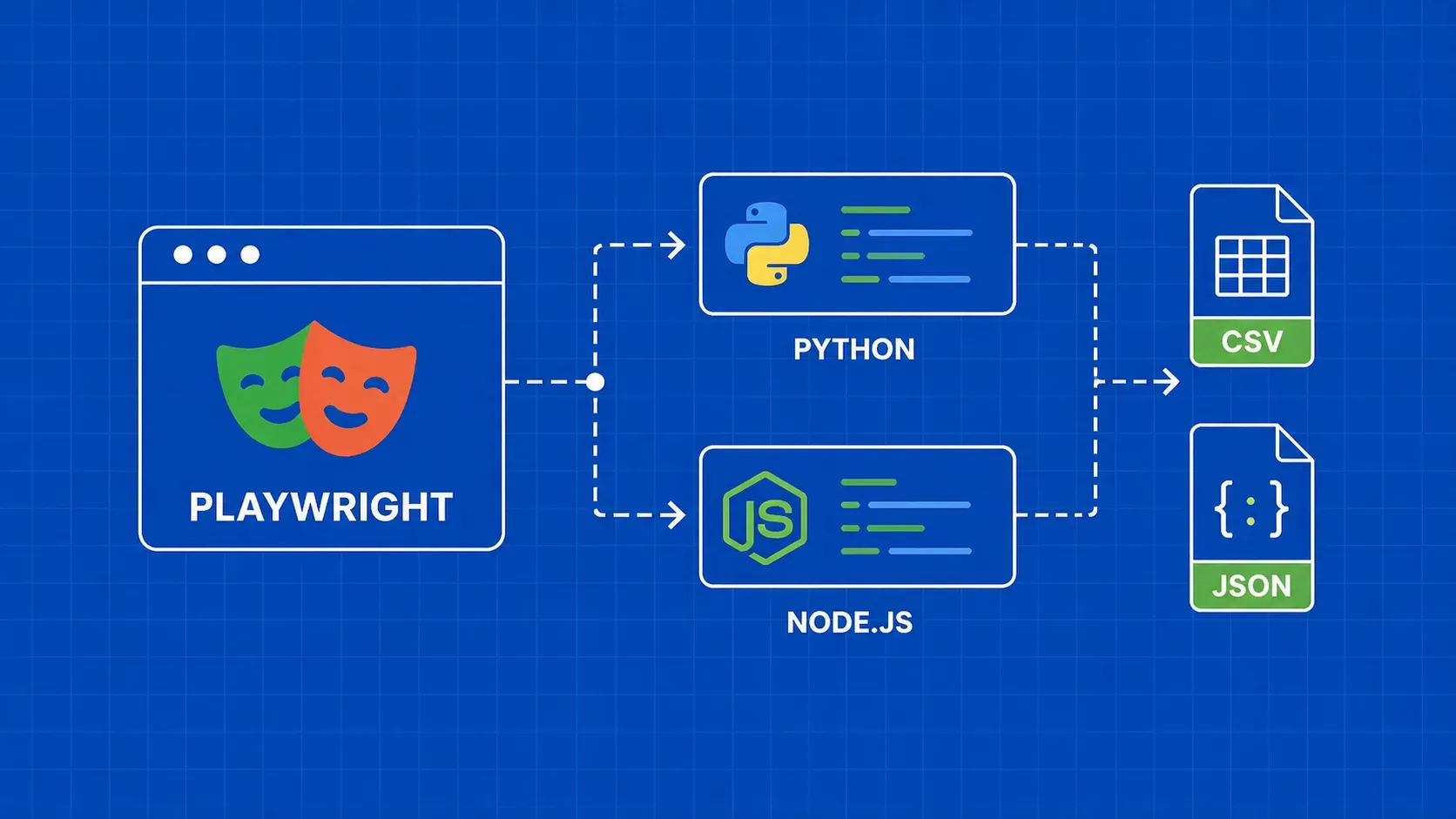

Kurz gesagt: Playwright bietet Ihnen umfassende Browser-Automatisierung zum Scrapen von JavaScript-lastigen Websites und unterstützt sowohl Python als auch Node.js. Dieser Leitfaden führt Sie durch die Installation, die Extraktion von Elementen, die Proxy-Konfiguration, Maßnahmen zur Vermeidung von Erkennung, Paginierung, das Herunterladen von Bildern und den Export von Daten in CSV oder JSON – alles mit Code-Beispielen in beiden Sprachen nebeneinander.

Wenn Sie schon einmal versucht haben, eine moderne Single-Page-Anwendung mit einem einfachen HTTP-Client zu scrapen, kennen Sie das Problem: Der zurückerhaltene HTML-Code ist eine leere Hülle, und die gewünschten Daten befinden sich in JavaScript, das nie ausgeführt wird. Playwright-Webscraping löst dieses Problem, indem es einen echten Browser (Chromium, Firefox oder WebKit) programmgesteuert steuert, sodass Ihr Skript genau das sieht, was ein menschlicher Besucher sehen würde.

Playwright ist ein von Microsoft gepflegtes Open-Source-Framework zur Browser-Automatisierung. Im Gegensatz zu älteren Tools verfügt es standardmäßig über integrierte Funktionen wie automatisches Warten, Netzwerk-Interception und Unterstützung für mehrere Browser-Engines. Unabhängig davon, ob Sie Python oder Node.js verwenden, ist die API-Oberfläche nahezu identisch, sodass Sie die Sprache wählen können, die am besten zu Ihrem Stack passt.

Dieser Leitfaden behandelt alles, was Sie benötigen, um von einem leeren Terminal zu produktionsreifen Playwright-Scraping-Skripten zu gelangen: Einrichtung, Selektoren, Text- und Bildextraktion, Paginierung, Request-Interception, Proxy-Konfiguration, Stealth-Techniken, Fehlerbehandlung und Export strukturierter Daten. Jede Technik enthält Code sowohl für Python als auch für Node.js.