Kurzfassung: Mit Puppeteer haben Sie von Node.js aus die volle Kontrolle über eine Headless-Chrome-Instanz, was es zum Werkzeug der Wahl für das Scraping von JavaScript-gerenderten Seiten macht. Dieser Leitfaden führt Sie durch die Installation, die selektorbasierte Extraktion, Infinite Scroll, die Anmeldung über Formulare, das Abfangen von Anfragen, Stealth-Plugins, den Export strukturierter Daten und die Bereitstellung mit Docker, damit Sie von einem einfachen Testskript zu einem Scraper für den produktiven Einsatz gelangen.

Web-Scraping ist die Praxis, Daten programmgesteuert von Websites zu extrahieren, und wenn diese Websites auf clientseitiges JavaScript zurückgreifen, um ihre Inhalte darzustellen, reicht eine einfache HTTP-Anfrage nicht aus. Sie benötigen einen echten Browser oder zumindest etwas, das sich wie einer verhält. Genau dieses Problem sollte Puppeteer lösen.

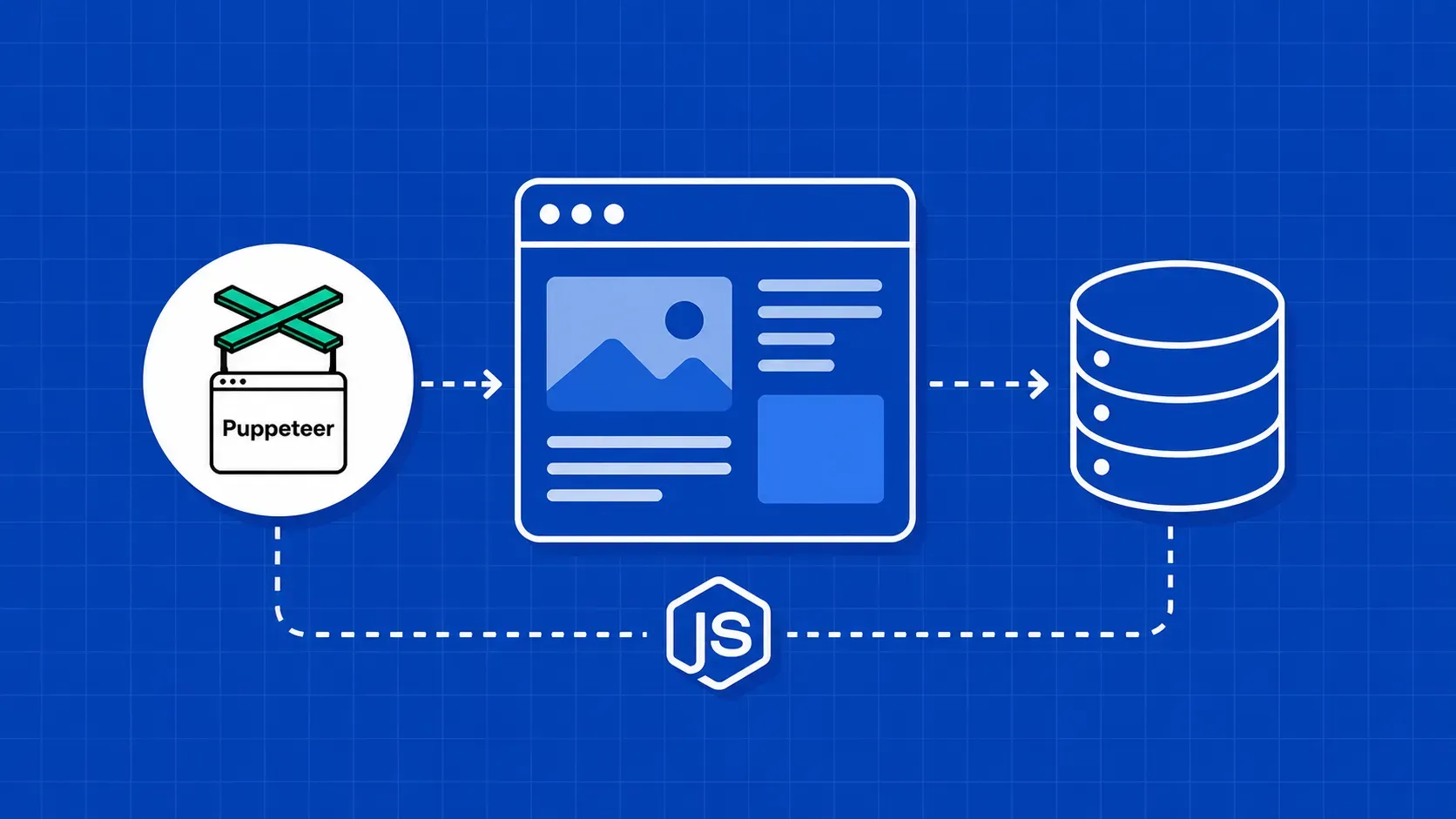

Puppeteer ist eine Node.js-Bibliothek, mit der Sie Web-Scraping mit Puppeteer und Node.js durchführen können, indem Sie eine headless (oder headful) Chrome-Instanz über das Chrome DevTools-Protokoll steuern. Es kann auf Schaltflächen klicken, Formulare ausfüllen, Seiten scrollen und beliebiges JavaScript im Seitenkontext auswerten und die Ergebnisse dann an Ihr Skript zurückgeben. Für Entwickler, die bereits mit JavaScript vertraut sind, ist dies einer der natürlichsten Wege in die JavaScript-Workflows für Headless-Browser-Scraping.

In diesem Tutorial lernen Sie, wie Sie ein Puppeteer-Projekt von Grund auf einrichten, Daten aus statischen und dynamischen Seiten extrahieren, mit Paginierung und unendlichem Scrollen umgehen, versteckte API-Aufrufe abfangen, Bot-Erkennung vermeiden, Ihre Ergebnisse in JSON und CSV exportieren und das Ganze in einem Docker-Container bereitstellen. Alle Code-Beispiele sind für Node.js 18 oder höher ausgelegt, und wir beziehen uns durchgehend auf die Puppeteer v24-API. Ganz gleich, ob Sie einen Preis-Tracker, eine Pipeline zur Lead-Generierung oder ein akademisches Forschungstool entwickeln – die Muster in diesem Leitfaden bringen Sie schneller in die Produktion.